En sonunda yapay zekalar da virüs saldırılarına karşı savunmasız değil. Yapılan yeni bir araştırma, bir virüsün ChatGPT ve Google Gemini’nin güvenlik önlemlerini aşabildiğini gösteriyor. Geçtiğimiz yıl, birbirine entegre üretken yapay zeka ekosistemleri oluşturan birçok şirket, yeni ve mevcut uygulamalarına bu teknolojileri entegre etti. Ancak uzmanlar, diyalog zehirlenmesi, gizlilik sızıntıları ve jailbreak gibi kritik sorunlarda uyarıda bulunuyor.

Yapılan yeni çalışmada, araştırmacılar kendi kendini kopyalayan istemleri kullanarak üretken yapay zeka ekosistemlerini hedef alan ilk solucanı geliştirdi. Morris II adını taşıyan bu yapay zeka virüsü, e-posta asistanlarının kişisel verilerini sızdırmak ve spam e-postalar göndermek gibi zararlı faaliyetlere neden oldu.

Araştırmacılar, bu “sıfır tıklamalı” yapay zeka solucanının metin ve görüntü girdileri aracılığıyla düşmanca bir istem kullanarak ChatGPT, Gemini ve açık kaynaklı yapay zeka modeli LLaVA’dan yararlandığını tespit etti. Bu sayede solucanın, ekosistem içindeki bağlantılardan yararlanarak saldırıyı diğer yapay zeka modellerine de yayabileceği belirlendi.

Virüsün potansiyel kullanım alanları arasında kimlik avı saldırıları düzenleme, spam e-postalar gönderme ve hatta propaganda yayma bulunuyor. Araştırma, bu virüsün GenAI araçlarını oluşturan büyük dil modellerinin bilgisayar virüsleri tehdidine karşı bağışık olmadığını açıkça ortaya koyuyor.

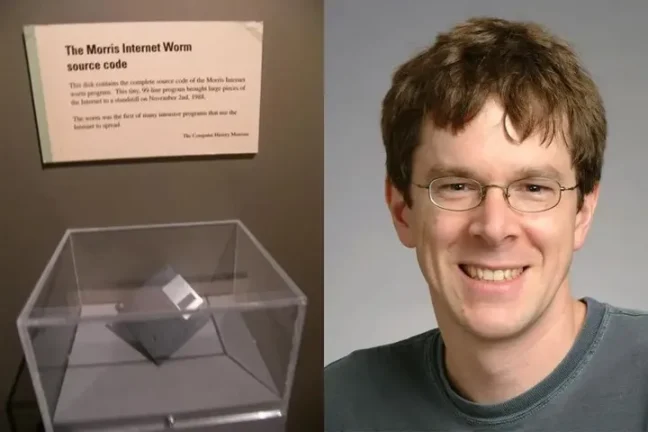

Morris II, adını 1988 yılında Cornell öğrencisi Robert Morris tarafından geliştirilen ve o dönemde internete bağlı bilgisayarların yaklaşık %10’unu çökerten ilk kendi kendini kopyalayan bilgisayar solucanlarından biri olan Morris Worm’dan alıyor. Araştırmacılara göre, üretken yapay zeka ekosistemlerindeki kötü mimari tasarım, kendi kendini kopyalayan kötü amaçlı yazılımların oluşmasına olanak tanıyor. Bu da, GenAI araçlarının daha güvenli hale getirilmesi gerektiğine işaret ediyor. Eğer bu tür bir yazılım günümüzde veya gelecekte GenAI ekosistemlerine bulaşırsa, etkileri oldukça büyük olabilir.