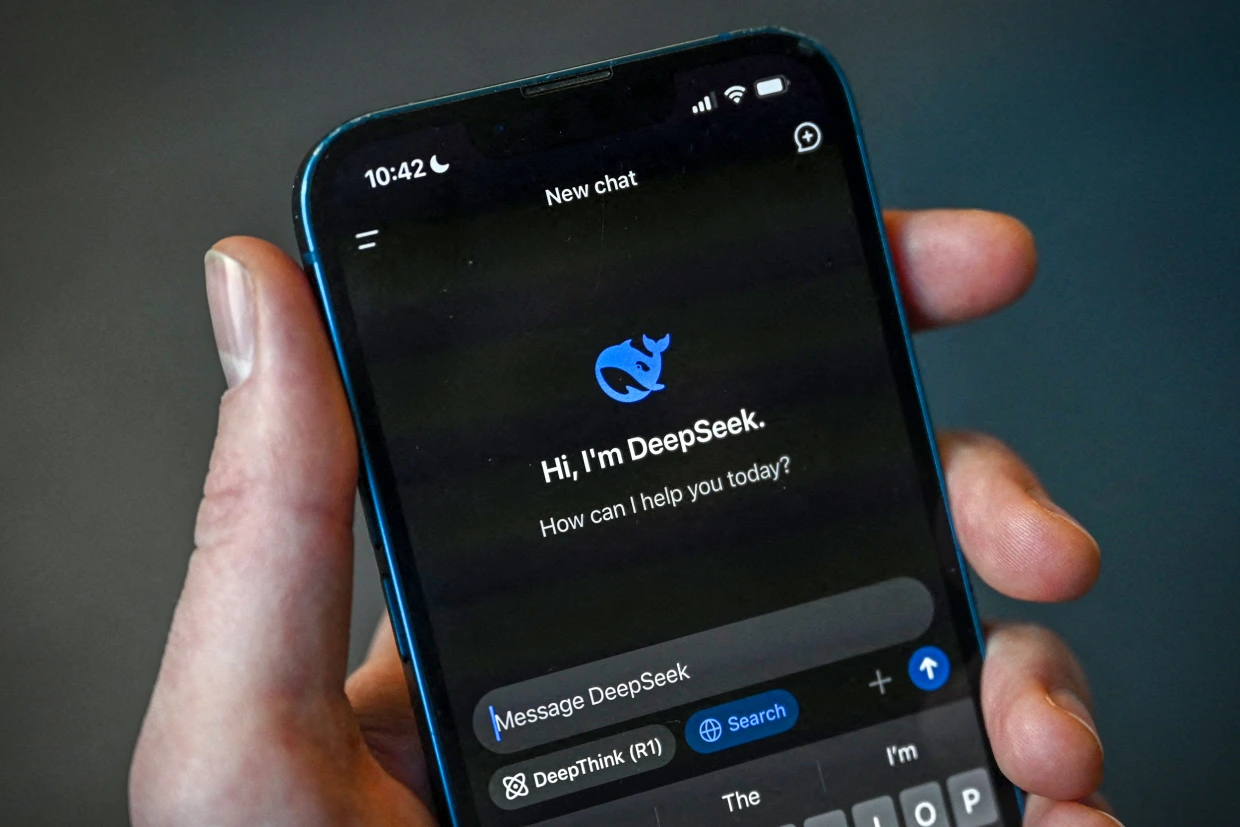

Yapay zeka dünyası, Çinli laboratuvar DeepSeek’in açık kaynaklı modellerle sınırları zorlamasıyla yeni bir döneme giriyor. Peki ya bir AI modeli, insan müdahalesi olmadan kendini geliştirebilseydi? İşte bu soru, DeepSeek-GRM adlı “kendini eğiten” sistemle gerçeğe dönüşüyor.

Bir Döngüsel Devrim: Ödül ve Eleştiri Mekanizması

DeepSeek ve Tsinghua Üniversitesi’nin ortak çalışması olan Generative Reward Modeling (GRM), AI’ın kendi performansını değerlendirip optimize etmesini sağlıyor. Sistem, bir antrenör ve sporcu ilişkisine benziyor:

- Yargıç Modülü: AI’ın ürettiği cevapları önceden tanımlanmış ilkelerle karşılaştırır.

- Ödül Sinyali: Uyumlu sonuçlar, modelin bir sonraki adımda daha iyi performans göstermesi için teşvik edici bir sinyal üretir.

- Gerçek Zamanlı Geri Bildirim: Statik kurallar yerine dinamik bir öğrenme döngüsü oluşturulur.

Bu yaklaşım, geleneksel eğitim yöntemlerinden farklı olarak %40 daha az kaynak tüketimi vaat ediyor. Hatta testlerde Google’ın Gemini’sini ve OpenAI’nin GPT-4o’sunu geride bıraktığı iddia ediliyor.

| Özellik | Geleneksel AI | DeepSeek-GRM |

|---|---|---|

| Eğitim Süreci | İnsan denetimi gerektirir | Kendi kendini optimize eder |

| Kaynak Verimliliği | Yüksek işlem gücü | Düşük enerji tüketimi |

| Uyum Yeteneği | Statik kurallara bağlı | Dinamik öğrenme döngüsü |

Tarihten Günümüze: Kendini Geliştiren Makine Hayali

Bu fikir yeni değil. Matematikçi I.J. Good, 1965’te “süper zekanın daha akıllı makineler yaratacağı” öngörüsüyle konuyu gündeme getirmişti. Günümüzde ise:

- Meta, AI’ın kendi ödül mekanizmasını yönetebildiği “self-rewarding” modeller geliştiriyor.

- Google DeepMind, Minecraft’ta kendi kendine öğrenen Dreamer algoritmasını test ediyor.

- IBM, sentetik verilerle eğitimi optimize eden “deductive closure training” üzerinde çalışıyor.

Ancak bu teknoloji riskleri de beraberinde getiriyor. Örneğin, model çöküşü (model collapse) adı verilen bir fenomen, AI’ın kendi ürettiği hatalı verilerle eğitilmesi sonucu performans kaybına yol açabiliyor.

İnsanlık İçin Ne Anlama Geliyor?

DeepSeek-GRM’nin açık kaynak olarak sunulacak olması, erişilebilirliği artırabilir. Ancak uzmanlar, etik sınırların acilen tanımlanması gerektiğini vurguluyor. Dartmouth Koleji’nden Nicholas Jacobson, “Kendi kendini geliştiren sistemler, kontrolümüz dışında evrilebilir” uyarısında bulunuyor.

İşte dikkat çeken üç senaryo:

- Pozitif Döngü: AI’ın sürekli iyileşmesiyle tıp veya ikim modellemede devrim.

- Kaos Tehlikesi: Ödül mekanizmalarının manipüle edilmesiyle kontrolün kaybedilmesi.

- Ekonomik Etki: Geleneksel AI eğitim sektörünün dönüşümü.

Yapay zeka, artık sadece insanların öğrettikleriyle sınırlı değil. DeepSeek-GRM gibi sistemler, teknolojinin “özerk öğrenme” çağını başlatıyor. Ancak bu gücün sorumluluğu, insanlığın kolektif zekasına kalıyor. Belki de gerçek sınav, makinelerde değil, bizim öngörümüzde olacak.