İngiltere’de istihbarat teşkilatı GCHQ çatısı altında 2016 yılında kurulan Ulusal Siber Güvenlik Merkezi (NCSC), siber suçluların halihazırda yapay zekâ uygulamalarını çeşitli amaçlarla kullandığını ve bu olgunun önümüzdeki iki yıl içinde daha da kötüleşerek siber saldırıların hacmini ve şiddetini artırmaya yardımcı olmasının beklendiğini söylüyor.

NCSC, yapay zekânın aslında deneyimsiz tehdit aktörlerinin, kiralık bilgisayar korsanlarının ve düşük vasıflı hacktivistlerin, aksi takdirde önemli ölçüde zaman, teknik bilgi ve operasyonel çaba gerektirecek daha etkili, özel saldırılar gerçekleştirmelerini sağlayacağına inanıyor. ChatGPT ve Bing Chat gibi mevcut büyük öğrenme modeli (LLM) platformlarının çoğu, platformun kötü amaçlı içerik oluşturmasını engelleyen güvenlik önlemlerine sahip. Ancak kısa bir süre önce Robust Intelligence ve Yale Üniversitesi’ndeki araştırmacıların da bilimsel bir makalede ortaya koyduğu üzere bu güvenlik önlemlerini yine bir yapay zekâ kullanarak aşmak son derece kolay.

NCSC de tam olarak bu konuya dikkat çekerek siber suçluların suç faaliyetlerini desteklemek için özel olarak tasarlanmış üretken yapay zekâ hizmetleri hazırladıkları ve pazarladıkları konusunda uyarıyor. Örnekler arasında, tehdit aktörlerinin kötü amaçlı yazılım ve kimlik avı yemleri de dahil olmak üzere kötü amaçlı içerik oluşturmasına olanak tanıyan ücretli bir LLM hizmeti olan WormGPT yer alıyor.

Bu durum, teknolojinin kontrollü ve güvenli çerçevelerin sınırlarını çoktan aştığını ve daha geniş bir suç ekosisteminde erişilebilir hale geldiğini gösteriyor. NCSC ayrı bir tehdit değerlendirmesinde “Fidye yazılımı aktörleri de dahil olmak üzere tehdit aktörleri, keşif, kimlik avı ve kodlama gibi siber operasyonların verimliliğini ve etkinliğini artırmak için halihazırda yapay zekâyı kullanıyor” uyarısında bulunuyor: “Bu eğilim neredeyse kesin olarak 2025 ve sonrasında da devam edecektir.”

Rapor, yapay zekânın siber risk ortamındaki rolünün, dönüştürücü olmaktan ziyade mevcut tehditleri geliştiren evrimsel bir rol olmasının beklendiğini belirtiyor. NCSC’nin değerlendirmesinin kilit noktasında ise siber operasyonlarda sofistike YZ kullanımının, 2025 yılına kadar esas olarak kaliteli verilere, uzmanlığa ve kaynaklara erişimi olan aktörlerle sınırlı kalacağı ancak akabinde ciddi bir artış yaşanacağı uyarısı yer almakta. Değerlendirmeye göre yapay zekâ, daha hızlı, daha etkili veri analizi ve YZ modellerinin eğitilmesini sağlayarak siber saldırıları daha etkili hale getirecek.

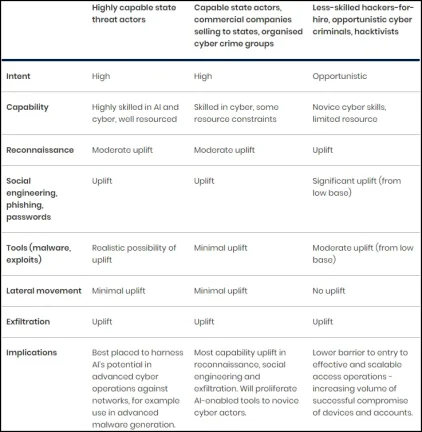

Yukarıda yer alan tablo, yapay zekânın üç beceri seviyesi için belirli tehdit alanları üzerindeki etkilerini özetliyor. NCSC, sofistike APT’ler için yapay zekânın, kaçamak özel kötü amaçlı yazılımları daha kolay ve daha hızlı üretmelerine yardımcı olacağına inanıyor. NCSC, “Yapay zekâ, mevcut güvenlik filtreleri tarafından tespit edilmekten kaçınabilecek kötü amaçlı yazılımlar üretme potansiyeline sahiptir, ancak yalnızca kaliteli istismar verileri üzerinde eğitilirse,” diye açıklıyor ve ekliyor: “Son derece yetenekli devletlerin, bu amaçla bir yapay zekâ modelini etkili bir şekilde eğitecek kadar büyük kötü amaçlı yazılım depolarına sahip olması gerçekçi bir olasılıktır.”

Genel olarak NCSC, üretken yapay zekâ ve büyük dil modellerinin, deneyim ve beceri düzeyi ne olursa olsun herkesin kimlik avı, sahtekarlık ve sosyal mühendislik girişimlerini tespit etmesini oldukça zorlaştıracağı konusunda uyarıyor.