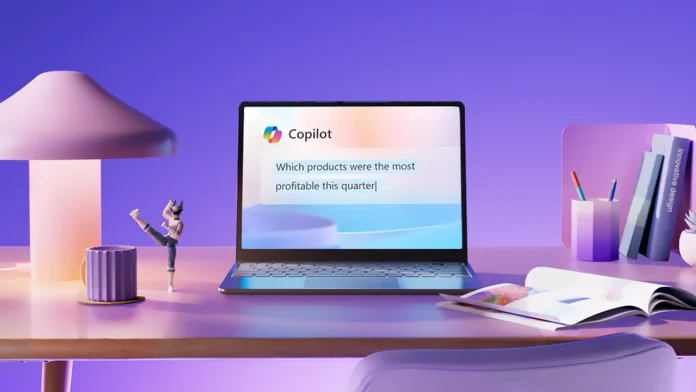

Microsoft bünyesinde görev yapan bir yapay zeka mühendisi, Copilot Designer yapay zekasıyla ilgili endişelerini ABD Federal Ticaret Komisyonu’na (FTC) taşıyarak şirketin dikkatini çekti. Bu eylem, daha önce DALL-E 3 yapay zekasındaki endişelerini dile getiren Shane Jones‘un, şirketin bu konudaki eksikliklerini gidermede yetersiz kaldığı iddiasını içeriyor.

Microsoft çalışanı Jones, FTC Başkanı Lina Khan‘a yazdığı mektupta, Copilot Designer’ın potansiyel olarak şiddet içerikli veya cinsel içerikli görseller üretebileceğini ve Microsoft‘un bu konuda yeterince etkili bir çözüm uygulamadığını belirtti. Çalışan, şirketi Copilot Designer’ı kamusal kullanımdan kaldırmaya çağırarak, yalnızca yetişkinlere yönelik bir derecelendirme alması gerektiğini vurguladı.

Jones, OpenAI‘ın Dall-E 3 aracının desteklediği Copilot Designer’ın, basit komutlarla cinsel içerikli, şiddet içeren veya zararlı görseller üretebildiğini öne sürdü. Bu iddiaların detaylı bir şekilde incelenmesi için yeterli kaynağın olmadığını iddia eden Microsoft‘un Copilot ekibinin, günde 1.000’den fazla ürün geri bildirim şikayeti aldığı ancak bu sorunları çözmek için yeterli kaynağa sahip olmadığı yönünde ifadelerini aktardı.

Microsoft çalışanı endişelerini politikalara uygun bir şekilde ele almaya kararlı olduğunu belirten açıklamalarına rağmen, Jones‘un şikayetleri, yapay zeka tabanlı **Copilot Designer’ın güvenlik açıklarına ve potansiyel tehlikelere dair geniş bir soru işareti oluşturuyor.

Bu olay, daha önce Copilot Designer’ın Taylor Swift’in müstehcen görüntülerini oluşturması ve Google‘ın Gemini yapay zekasının tarihsel olarak doğru olmayan görüntüler üretmesi gibi benzer sorunlarla örtüşmekte, yapay zekanın etik ve güvenlik konularındaki tartışmaları bir kez daha gündeme getirmektedir.